医疗AI过去几年一直在USMLE选择题上刷分,但OpenAI这次直接把游戏规则改了——发布HealthBench Professional,525个真实临床任务,每个样本由3位以上医生撰写、审核、裁定,全部MIT协议开源上Hugging Face。更猛的是,GPT-5.4在这套评测里拿了59分,而真人医生baseline只有43.7分。医疗AI评测,从此进入"真医生审稿"时代。

医疗AI刷了三年选择题,OpenAI说:够了

过去三年,医疗AI最大的光环就是USMLE刷分。

GPT-4、Med-PaLM 2、Gemini,一个接一个在MedQA上跑出85%、90%的高分,甚至超过了人类医生的通过线。每次一出分,行业就高喊"AI要取代医生了"。

但真正在临床一线的人都知道,做选择题和看病人,完全是两回事。

真实的临床场景里,信息是残缺的,诊断是模糊的,医生需要在不确定性中做判断、写病历、查文献、和同事讨论病例。哪一件事是"ABCD选一个"能覆盖的?

OpenAI Health AI负责人之一Karan Singhal在2025年就公开批评过这个问题。他在个人文章《Levels of Clinical Evaluation》里说得很直白:社区过去太聚焦窄任务和自动化考试型评估,应该往更接近真实部署的层级走。

一年后,他把这句话变成了产品。

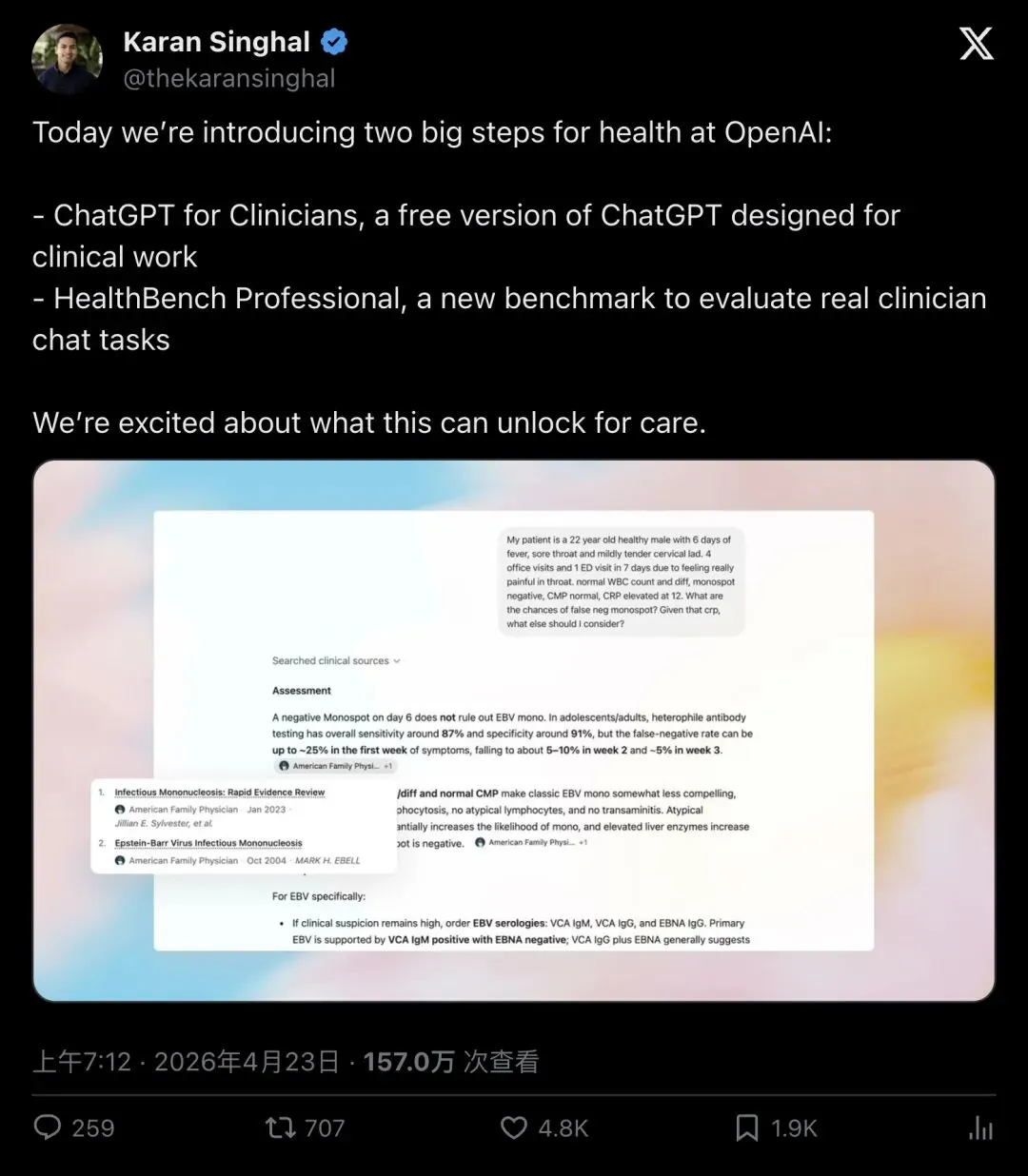

▲ Karan Singhal 4月23日发帖,宣布OpenAI在医疗健康方向的"两步大棋"——ChatGPT for Clinicians + HealthBench Professional,近5000赞、157万次浏览

两步棋:先给工具,再立规矩

4月22日,OpenAI官方发布《Making ChatGPT better for clinicians》,一口气端出两个东西:

第一个是ChatGPT for Clinicians——面向美国已认证的医生、NP、PA、药师,免费开放。专门为临床工作设计,覆盖病历文书、医学研究、临床咨询三大场景。

第二个就是HealthBench Professional——一个全新的开放评测集,专门评估AI在真实临床聊天任务中的表现。

这两步的顺序很有讲究。先给医生一个专用工具,再给行业一把衡量工具好坏的尺子。OpenAI想做的事情很清楚:把"怎么评医疗AI"这件事也拿到手里。

而且这把尺子,和以前的完全不同。

525道题,每题3个医生过堂

HealthBench Professional到底长什么样?

根据OpenAI放出的官方PDF和Hugging Face上的数据集,关键参数如下:

- 525个医生撰写的临床任务

三类使用场景:临床咨询(care consult)236个、写作与文书(writing and documentation)142个、医学研究(medical research)147个 覆盖28个专科,心内科和神经内科各占43个样本 候选池15,079条,对困难样本做了3.5倍富集 约三分之一的样本来自医生故意做的对抗性测试(adversarial testing)

最核心的一句话来自Karan的种子帖:

"Each example was written, reviewed, and adjudicated by three or more physicians."

「每个样本都经过三位或以上医生撰写、审核与裁定。」

这意味着什么?每道题从出题、审题到最终定稿,都要经过至少三个真人医生的手。这套流程,和医学期刊的同行评审几乎一模一样。

▲ Karan Singhal 4月27日再发帖,专门强调HealthBench Professional已上Hugging Face,"每条样本3位以上医生参与"——149赞、1.6万次浏览

从"做题"到"干活":评的到底是什么?

过去的医疗benchmark问的是:模型知不知道答案。

HealthBench Professional问的是:模型能不能在医生的工作流里交作业,而且交出来的东西安全、有用。

举个例子。传统MedQA的题目可能是:"22岁男性,发热6天,咽痛,颈部淋巴结轻度压痛……最可能的诊断是什么?A. 单核细胞增多症 B. 链球菌咽炎 C. 急性HIV D. 巨细胞病毒感染"。

而HealthBench Professional的任务可能是:一个医生直接把上面这段病史丢给AI,然后问——"单核检测阴性但CRP升高,假阴性概率多大?还该查什么?"没有ABCD,没有标准答案,只有真实工作中医生会问的问题。

AI需要给出的回答,要经过rubric(评分标准)的细粒度打分。这些rubric本身也是医生写的,也经过了多轮审核。

OpenAI官方页面对这个定位说得很明确:

"an open benchmark for real clinician chat tasks across three use cases: care consult, writing and documentation, and medical research"

「一个面向真实临床聊天任务的开放benchmark,覆盖临床咨询、写作与文书、医学研究三类场景。」

GPT-5.4拿了59分,真人医生43.7分

OpenAI在PDF里公布了自家模型的成绩:

- ChatGPT for Clinicians(基于GPT-5.4):59.0分

- 基础版GPT-5.4:48.1分

- 真人医生基线:43.7分

在最难的红队测试切片(Likert 1-2难度)中,差距更大:ChatGPT for Clinicians拿了55.8分,真人医生只有30.0分,基础版GPT-5.4更是只有26.2分。

写作与文书、医学研究这两个场景上,AI的优势尤其明显。

但必须说清楚:这是OpenAI在自家benchmark上、用自家产品跑出来的成绩。

这和独立第三方临床试验的结论完全是两回事。在OpenAI定义的评测框架里,用OpenAI的模型当grader,评估OpenAI的产品——这个利益关系链条,读者需要自己判断。

开源这件事,才是最大的后手

很多人看到HealthBench Professional的第一反应是"又一个benchmark"。

但这次不同,因为它是真开源。

MIT协议,Hugging Face直接可下载,数据字段全公开——conversation、rubric_items、use_case、difficulty、specialty、physician_response,全都在。

▲ DailyPapers在4月26日转发,强调"physician-curated conversations + rubric-based grading across specialties"——237赞、2.4万次浏览

DailyPapers/HuggingPapers的二次传播,抓住了最核心的几个关键词:上Hugging Face、医生策划、rubric评分、跨专科。

这意味着任何开源模型团队、医疗AI创业公司、医院研究组,都可以拿这套东西直接跑自己的模型。以前"只看到论文、拿不到数据"的卡点,被推平了。

当一个benchmark从"自家产品附件"变成"行业公共设施",它的意义就完全不同了。

72%的美国医生已经在用AI了

OpenAI在官方产品页里还放了一个数据:2026年AMA调查显示,72%的美国医生表示已在临床实践中使用AI,而去年这个数字是48%。

此外:

医生顾问团队已审阅超过70万条健康场景模型回答 产品上线前测试了6,924段医生真实工作对话 - 99.6%

的回答被医生评为安全且准确

这些数字同样来自OpenAI官方表述。但它们指向一个趋势:医生使用AI辅助已经从"尝鲜"变成了常态,评测标准的升级只是迟早的事。

这场游戏才刚开始

HealthBench Professional真正的后续看点,在于它能不能成为行业公共标准。

如果只有OpenAI自己在用,它就只是一个产品附件。但如果Google、Anthropic、开源社区都开始在这套框架上跑分,它就会变成医疗AI领域的"新MedQA"。

从2025年原版HealthBench的5000段对话、262位医生、26个专科,到2026年Professional版的525道精选题、3位以上医生审稿、28个专科——OpenAI花了一年,把这条路从概念验证推到了产品化落地。

现在球踢到了行业这边:你家的模型,敢不敢拿真医生的工作任务来考?

— END —